Vorbemerkung

"Künstliche Intelligenz" (auf Englisch "Artificial Intelligence", AI) in Bildbearbeitungsprogrammen ist momentan schwer in Mode. Als Erstes ist einmal die Frage zu stellen, was dahintersteckt! Künstliche Intelligenz - so die momentan vorherrschende Definition in diesem Zusammenhang - steht im Kontext mit "big data", also großen Datenmengen. Mit Hilfe dieser Daten kann ein "Deep learning" stattfinden, das dann eine Art Algorithmus produziert, der in bestimmten Situationen verwendet werden kann. Oft finden hier "neuronale Netze" ihre Anwendung, die eben vorher entsprechend trainiert wurden.Aber schon früher gab es Bildbearbeitungsmöglichkeiten, die an künstliche Intelligenz denken ließen. Schon 2005 bis 2007 wurde ein - damals revolutionär erscheinender - Algorithmus namens "Seam-Carving" entwickelt, der hier auch in 2009 vorgestellt wurde. Mit seiner Hilfe wurde man in die Lage versetzt, Bilder zum Beispiel in der Breite zu verändern, ohne eben einfach zu strecken oder zu stauchen. "Content-aware resizing" war ein damals in diesem Zusammenhang gebrauchter Begriff. Adobes Photoshop bot dies ab der Version CS4 an - und auch für GIMP gibt es ein kostenloses Plugin (Liquid Rescale, hier in 2014 vorgestellt), was dies erlaubt.

Ein Ergebnis dieser Vorgehensweise ist die "kontextsensitive Retusche", die in vielen Programen unterdessen angeboten wird. Hier kann man "Fehlstellen" in Bildern übermalen - aber nicht einfach mit einer Farbe, sondern mit Mustern, die der Umgebung angepasst werden. Eigentlich ist dies also eine Abart des "Klonens".

Eine andere Entwicklung, die man auch grob diesem Bereich zurechnen kann, ist die Unterstützung verschiedener Freistellungsmöglichkeiten.  Der "Zauberstab", heutzutage in fast allen Bildbearbeitungsprogrammen zu finden, gehört in diese Gruppe. Hier muss kein Hintergrund "ergänzt", aber Objektgrenzen identifiziert werden. Dies funktionierte bisher über das Auffinden von Farbgemeinsamkeiten und Kontrastunterschieden. Besonders bei Personen - und hier insbesondere bei Kleidung oder den Haaren - bereitet dies aber durchaus Probleme.

Der "Zauberstab", heutzutage in fast allen Bildbearbeitungsprogrammen zu finden, gehört in diese Gruppe. Hier muss kein Hintergrund "ergänzt", aber Objektgrenzen identifiziert werden. Dies funktionierte bisher über das Auffinden von Farbgemeinsamkeiten und Kontrastunterschieden. Besonders bei Personen - und hier insbesondere bei Kleidung oder den Haaren - bereitet dies aber durchaus Probleme.

Aber die Nutzung von "big data" führt zu neuen Möglichkeiten, die wir nun einmal exemplarisch an zwei Programmen anschauen wollen: Luminar 4 und Photoshop CC - und zurzeit kann man Luminiar 4 sogar kostenlos als dauerhaft funktionierendes Programm erhalten (siehe unten).

Luminar 4 (Skylum)

Zurzeit (Mitte Januar 2022) kann man sich das Programm unter https://skylum.com/de/chip-luminar4 kostenlos herunterladen. Luminar 3 und 4 erschienen wohl ca. 2017. An KI-Elementen brachte Luminar 3 "Accent-AI" und einen "Sky-Enhancer" mit. In Luminar 4 wurde dies durch "Landscape-", "Skin-" und "Portrait-Enhancer", "AI-Structure", "Sky-Replacement"; "Augmented Sky" sowie "Sonnenstrahlen" ergänzt. Skylum, die Hersteller von Luminar 4, bewerben ihre KI als "expertenbasiert".

So basieren die besonderen Filter/Algorithmen wohl auf den Erfahrungen der entsprechenden Programmierer:innen.

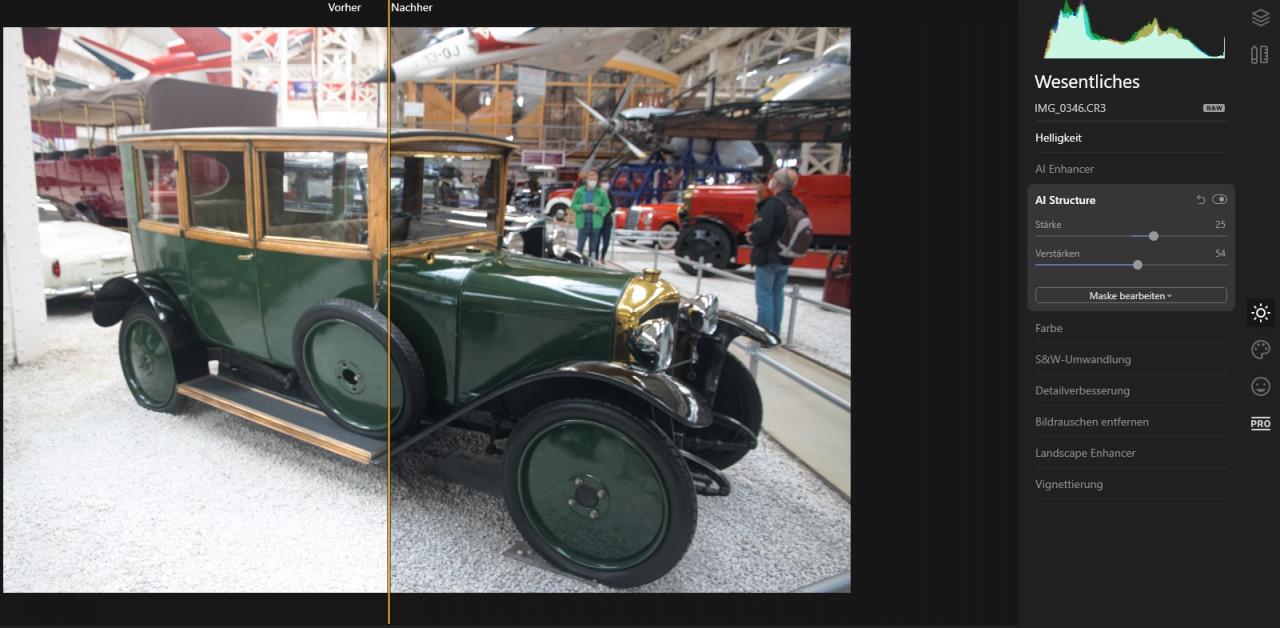

Schauen wir uns einmal zwei AI-Filter an:

|

Das linke Bild zeigt die Anwendung von "AI-Enhancer". Über einen Schieberegler wird hier eine "allgemeine Verbesserung" vorgenommen: Helligkeitsunterschiede werden angepasst, Kontraste an geeigneten Stellen angehoben. Das rechte Bild wurde mit "AI-Structure" verändert - hier fällt auf, dass eine Art Schärfung vorgenommen wurde, die anscheinend auf der Erhöhung von Kontrasten an kleineren Strukturen basiert. Beides sind - so denke ich - akzeptable Veränderungen, ja oft sogar Verbesserungen.

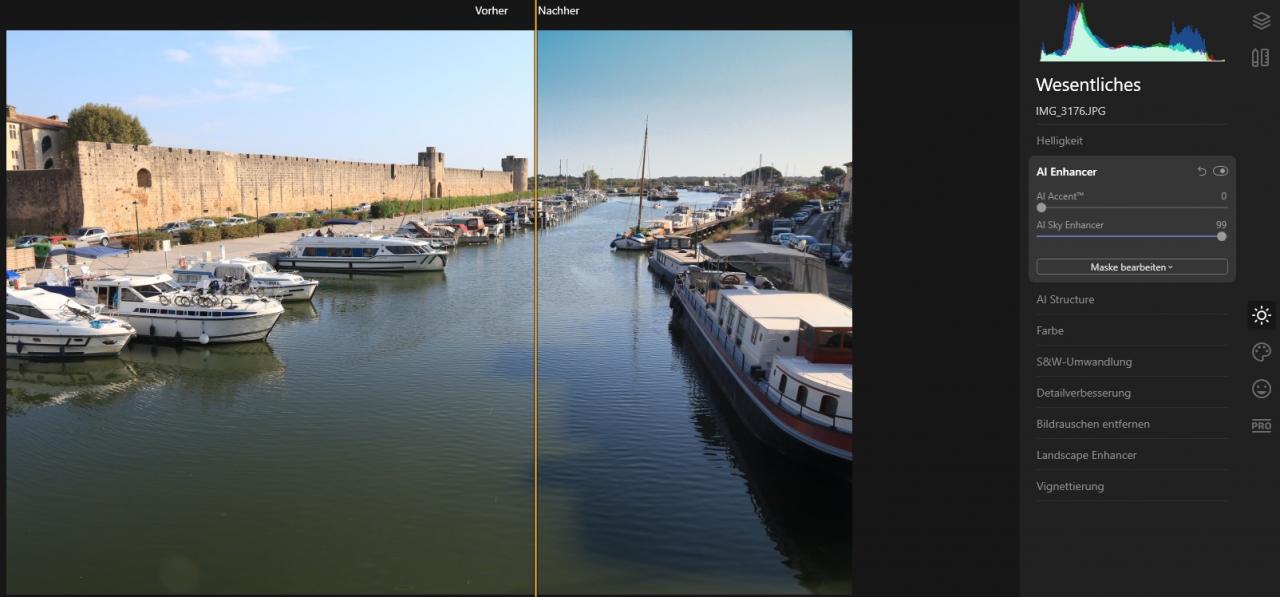

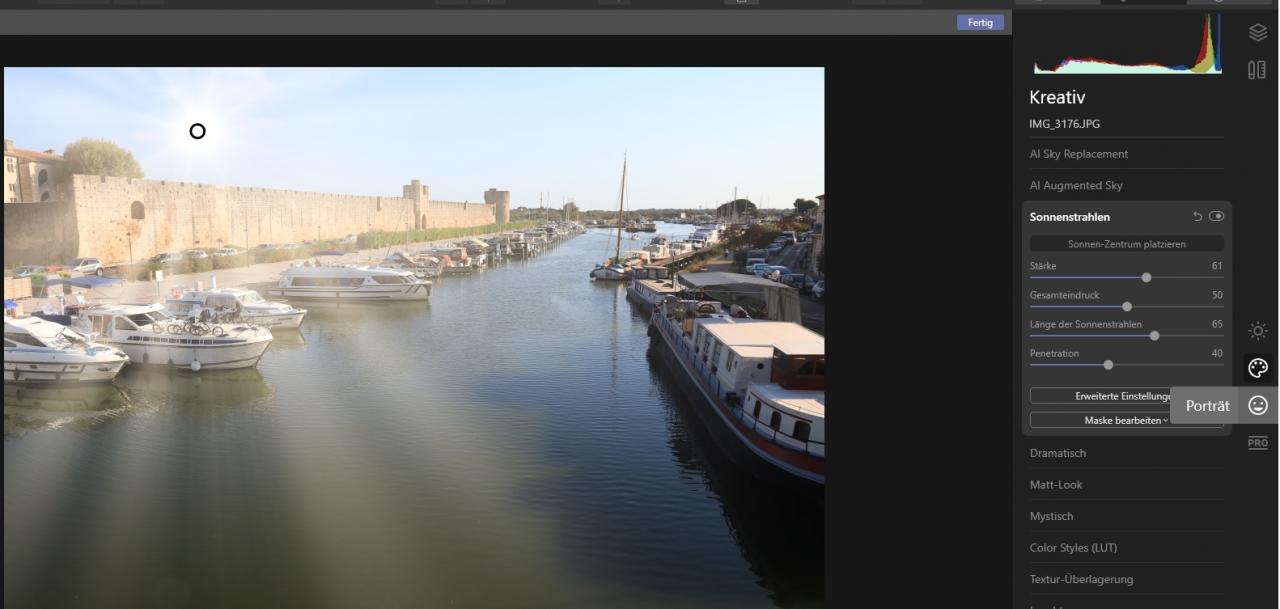

Stärkere Eingriffe in das Bild nehmen der "Sky-Enhancer" (Bild links) oder die "Sonnenstrahlen" (rechtes Bild) vor:

|

Während der Sky-Enhancer noch als Kombination mehrerer partieller Bildbearbeitungen (Helligkeit, Sättigung, ...) durchgehen kann, ergänzt der Filter "Sonnenstrahlen" das Bild um neue Inhalte. Die Position der Sonne wird frei gewählt, und die "Stärke" der Sonnenstrahlen eingestellt (im Bild mit Absicht etwas übertrieben gewählt).

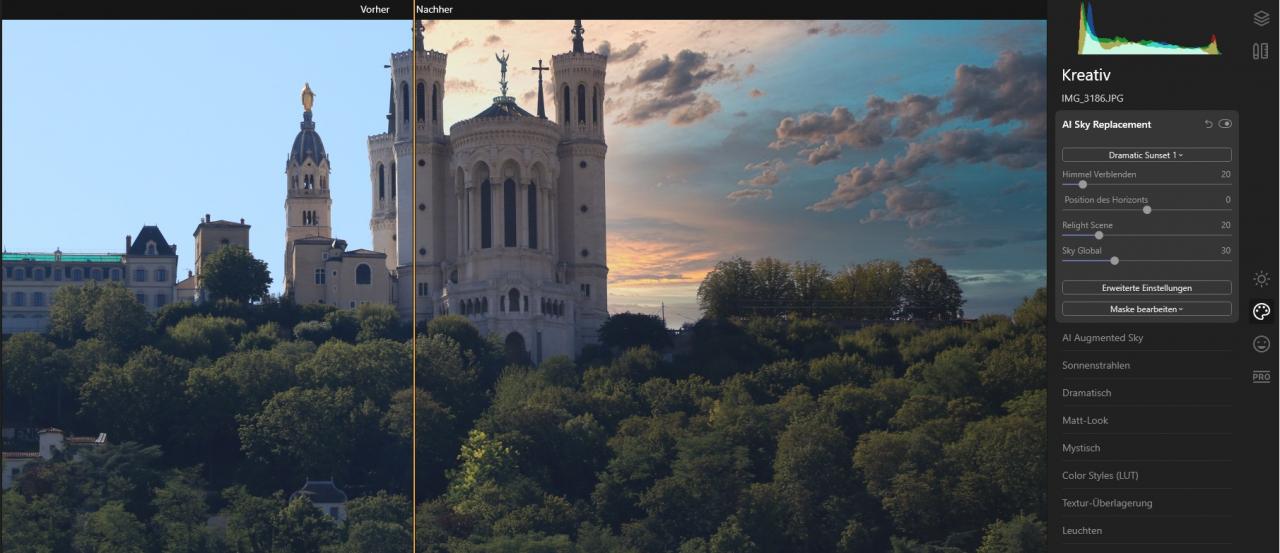

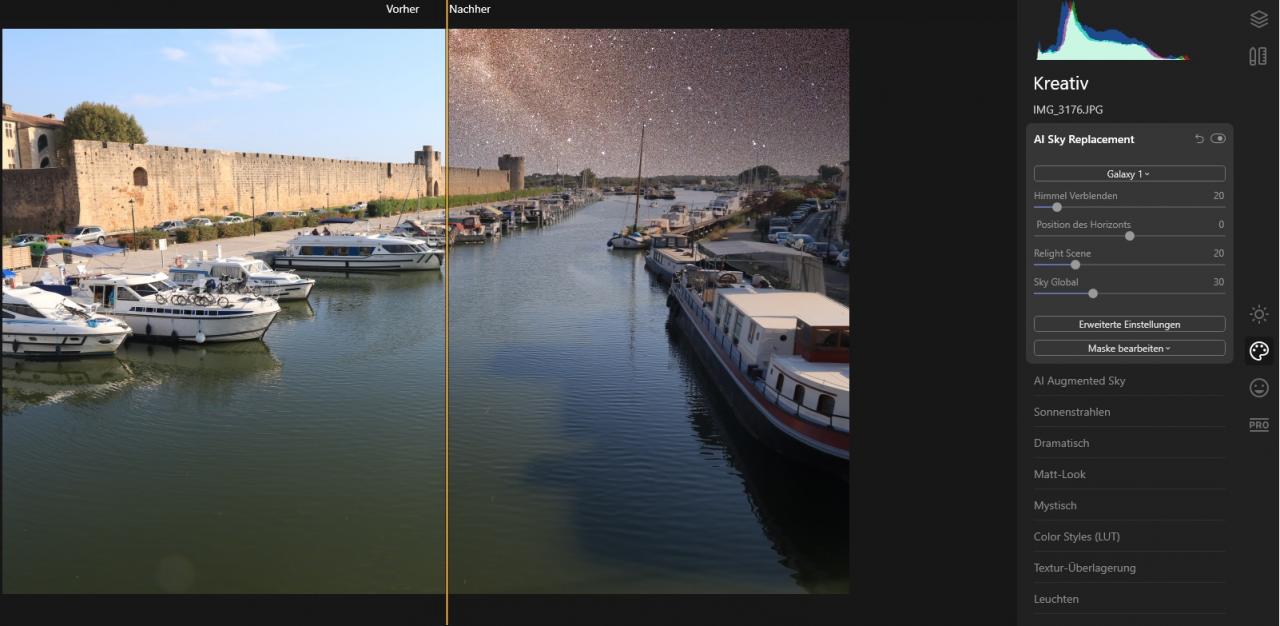

Deutlich massivere Eingriffe nimmt der Filter "AI-Sky-Replacement" vor:

|

Die "neuen Himmel" lassen sich aus einer Liste wählen: "Dramatic sunset" wurde im linken Bild angewandt, "Galaxy 1" im rechten. Die Leistung der "KI" besteht darin, die Himmelsgrenzen zu erkennen (was sie ganz gut kann) und auch den "Nicht-Himmel-Anteil" im Bild passend zum neu gewählte Himmel etwas anzupassen (Farbgebung, Helligkeit, Sättigung,...) - auch das gelingt eigentlich recht gut. Weitere als die mitgelieferten Himmel lassen sich bei Skylum - meist kostenpflichtig - als Download beziehen.

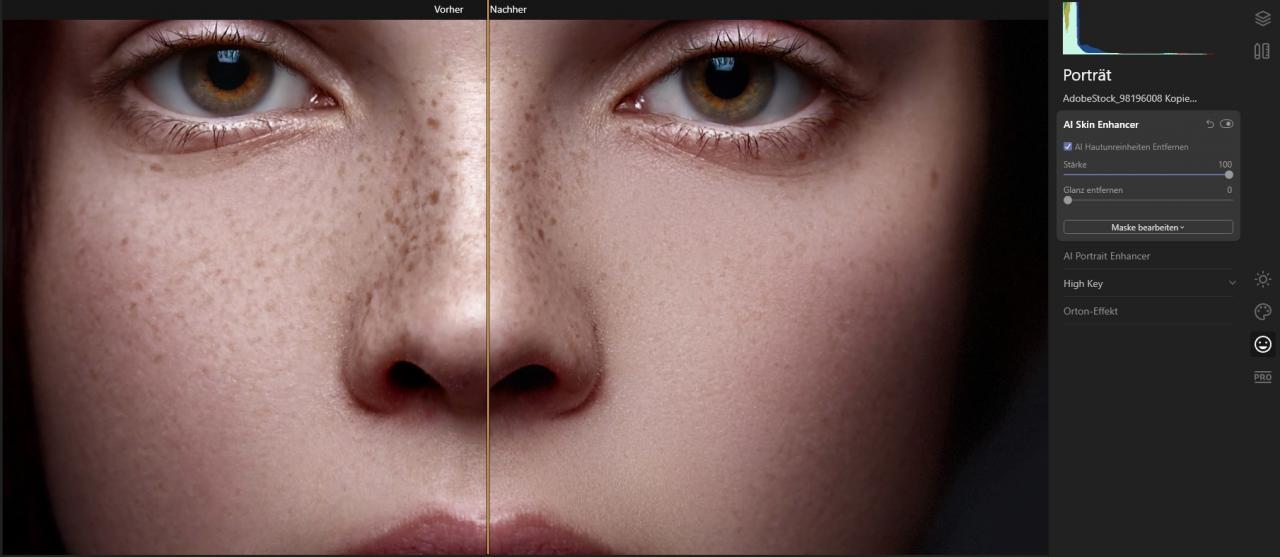

Die letzten beiden KI-gestützten Filter, die ich hie vorstellen will, sind der "AI-Skin-Enhancer" sowie der "AI-Portrait-Enhancer".

Der "Skin-Enhancer"  besitzt zwei Schieberegler: "Hautunreinheiten entfernen" und "Glanz entfernen". Hier wurde der erste der beiden bis zum Maximalwert benutzt.

besitzt zwei Schieberegler: "Hautunreinheiten entfernen" und "Glanz entfernen". Hier wurde der erste der beiden bis zum Maximalwert benutzt.

Im Ergebnis sieht man, dass auf der rechten Gesichtshälfte die meisten der zahlreichen Sommersprossen nun verschwunden sind. (Ob die Dame ihre Sommersprossen allerdings selbst als "Hautunreinheiten" beschreiben würde, sei einmal dahingestellt.) Das Ganze über ein Klon- oder Reparaturwerkzeug selbst vorzunehmen ist sicher mit einem deutlich höheren Arbeitsaufwand verbunden, als diesen einen Regler zu betätigen.

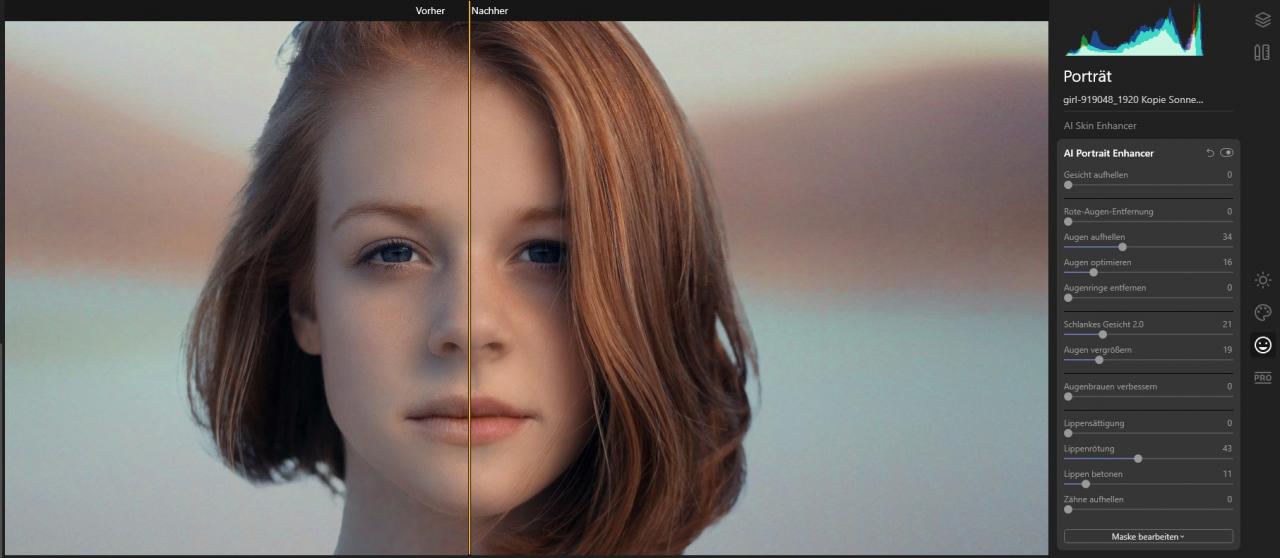

Der "AI -Portrait-Enhancer" ist der Filter mit den meisten Einstellungsmöglichkeiten und damit auch dem höchsten Veränderungspotential. Auf der rechten Seite des nebenstehenden Bildes kann man die vielfältigen Beeinflussungsmöglichkeiten erkennen: "Gesicht aufhellen", der Bereich "Augen" mit vier Reglern, "Schlankes Gesicht" und "Augen vergrößern" sind derzeit immer noch beliebte Manipulationen; "Augenbrauen verbessern" ist ein eigener Regler und weitere vier befassen sich mit Lippen und Zähnen. Insgesamt arbeiten diese Filterelemente einzeln jeweils durchaus dezent und "glaubwürdig" - in ihrer Gesamtheit können sie aber große Veränderungen bewirken, so dass das Ergebnis mit der "Wirklichkeit" unter Umständen nicht mehr viel zu tun hat.

-Portrait-Enhancer" ist der Filter mit den meisten Einstellungsmöglichkeiten und damit auch dem höchsten Veränderungspotential. Auf der rechten Seite des nebenstehenden Bildes kann man die vielfältigen Beeinflussungsmöglichkeiten erkennen: "Gesicht aufhellen", der Bereich "Augen" mit vier Reglern, "Schlankes Gesicht" und "Augen vergrößern" sind derzeit immer noch beliebte Manipulationen; "Augenbrauen verbessern" ist ein eigener Regler und weitere vier befassen sich mit Lippen und Zähnen. Insgesamt arbeiten diese Filterelemente einzeln jeweils durchaus dezent und "glaubwürdig" - in ihrer Gesamtheit können sie aber große Veränderungen bewirken, so dass das Ergebnis mit der "Wirklichkeit" unter Umständen nicht mehr viel zu tun hat.

Photoshop CC und Lightroom (Adobe)

Adobes KI hat sogar einen eigenen Namen: Sensei - und ist in einigen Produkten dieser Firma nutzbar. Der Name kommt aus dem Japanischen und bedeutet Lehrer oder Meister. Adobe wirbt mit verschiedenen Fähigkeiten dieser KI. Über maschinelles Lernen und "Deep Learning" kann sie zum Beispiel automatisch Schlüsselwörter zu Fotos hinzufügen oder diese nach verschiedenen Gesichtspunkten markieren. Bei der Auswahl bestimmter Motive in Bildern kann sie diese vom Hintergrund freistellen und dabei sogar feine Details berücksichtigen. Automatische "Verbesserungen" (wie Belichtung, Kontrast, Farbanpassungen, Weißabgleich usw.) basieren auf einem Vergleich mit Tausenden von professionellen Bildern in Adobes Datenbanken - so wird das beworben. (Photoshop oder Lightroom gibt es nicht kostenlos - auch die Testversionen funktionieren nur wenige Tage. Will man die Produkte nutzen, geht das momentan nur über ein Abo.)

In Photoshop betrifft die Nutzung von Sensei viele verschiedene Punkte: den Reparaturpinsel, die Bereichsreparatur, das Austauschen des Himmels, die automatischen Korrekturen, den Menüpunkt "Motive finden" und die zur Zeit teilweise noch experimentellen "Neural filters".

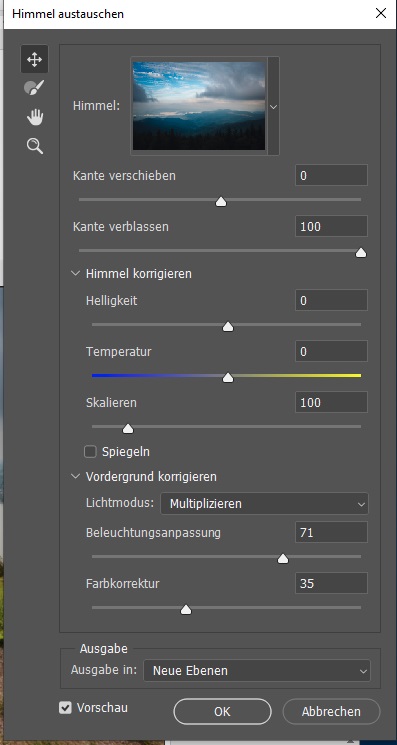

Schauen wir uns einige Elemente einmal an. "Himmel austauschen" kennt ja Luminar 4 auch - im Photoshop finden wir den Punkt "Himmel austauschen" im "Bearbeiten"-Menü.

|   |

Wenn Sie sich das mittlere Bildelement einmal näher anschauen, finden Sie die verschiedenen Bearbeitungsmöglichkeiten des "neuen Himmels". Mit am wichtigsten ist "Kante verschieben", das den "Horizont" betrifft, der ja automatisch ermittelt wird. Wie Sie sehen können, wird auch der "Nicht-Himmel-Anteil" im Bild etwas beeinflusst. (Um die Spiegelung im Fluss müsste man sich allerdings selbst kümmern.)

Auch bei Adobe gibt es downloadbare "Himmelpakete" zum Ergänzen der Auswahlliste.

"Motiv finden" ist ein Menüpunkt, der Sensei explizit nutzt. Durch den Vergleich mit anderen Bildern identifiziert dieser Filter ein oder mehrere Hauptmotive in einem Bild. Links sehen Sie das Originalbild. Im Auswahlmenü gibt es den Punkt "Motiv" - wählt man ihn an, befindet sich in bald ein Auswahlrähmchen um die junge Frau im Vordergrund. Ich habe diese Auswahl dann in eine schwarze Ebene kopiert (siehe rechtes Bild), damit man beurteilen kann, wie gut die automatische Auswahl - besonders im Bereich der Haare - wirklich ist.

|

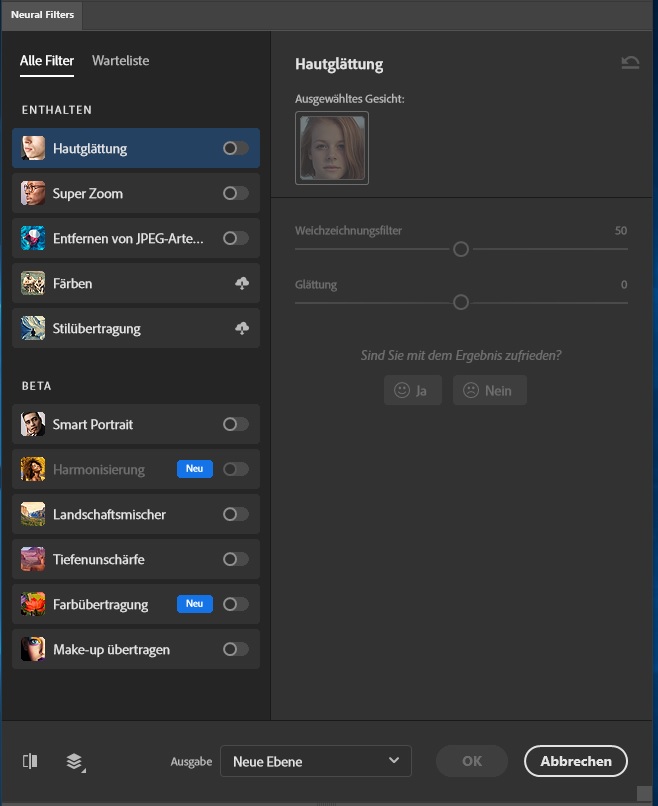

Eine ganz große "Wundertüte" sind die "Neural filters". Einige sind noch im experimentellen Stadium, und um sie zu verwenden, muss man sie erst einmal herunter laden. "Neural" soll wohl darauf hindeuten, dass trainierte neuronale Netze hinter den Algorithmen stecken - eine Aussage, die zu Adobes Erklärungen zu Sensei passt.

Rechts sehen Sie das Tableau zur Auswahl und Konfiguration dieser Filtergruppe. Manche Filter arbeiten direkt auf dem PC des Anwenders, andere arbeiten in der Cloud - also bei Adobe "zu Hause".

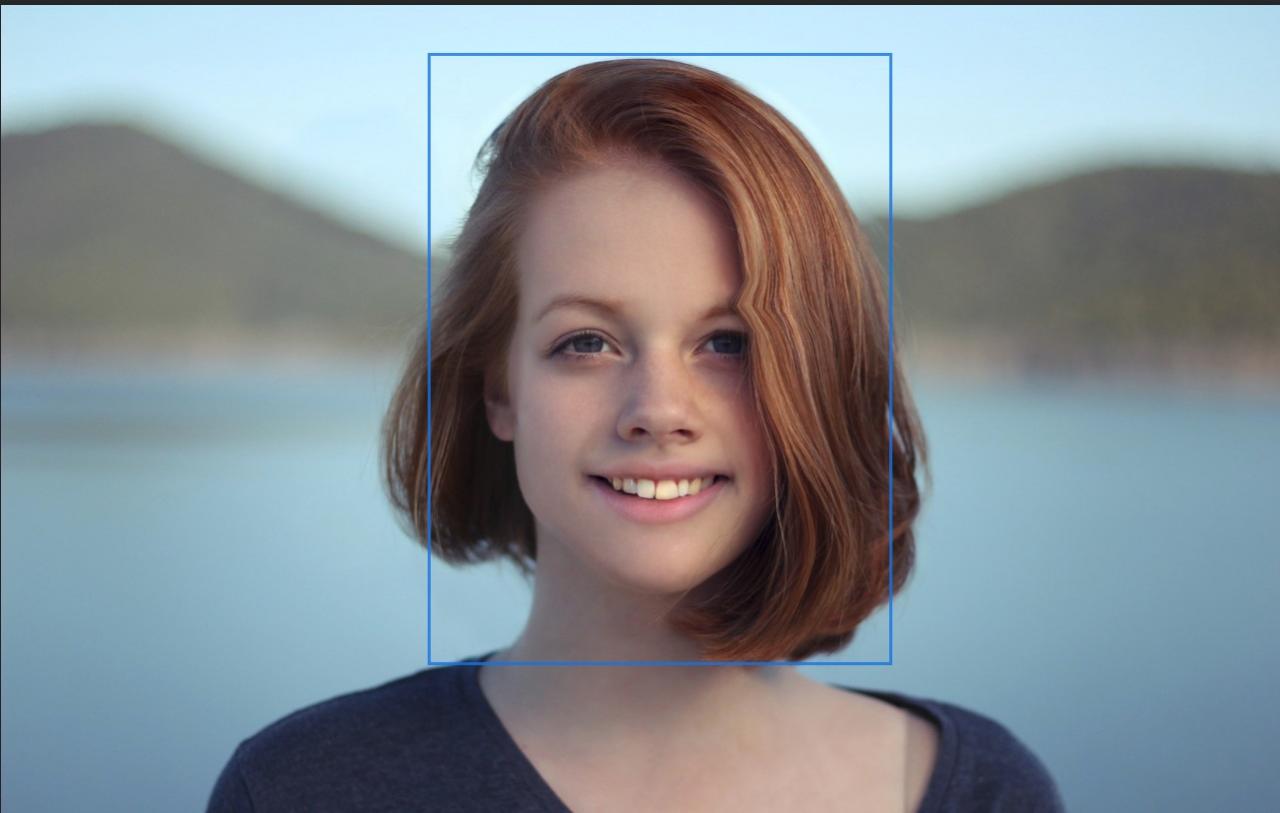

Mit am interessantesten finde ich "Smart Portrait" - eine Sammlung von Reglern, deren Modifikationsmöglichkeiten ich beeindruckend finde. Ruft man den Filter auf, versucht er, im vorhandenen Bild ein Gesicht zu finden - dieses versieht er mit einem blauen Rahmen. Zumindest zurzeit kann man diese Auswahl nicht beeinflussen.

An Reglern steht dann zur Verfügung: Glück, Gesichtszug, Haardichte, Augenrichtung, Überraschung, Wut, Kopfausrichtung, Lichtposition, sowie unter "Einstellungen": "Eindeutige Details beibehalten" und "Weiche Kante der Maske".

Leider wird gerade dieser Filter zurzeit noch (Jahresanfang 2022) häufiger mit einer entsprechenden Fehlermeldung wegen fehlerhaften Arbeitens für einige Tage deaktiviert.

Hier nun mal eine kleine Sammlung von Bearbeitungen eines Adobe-Stock-Bildes. Die Modifikationen sind jeweils darunter angegeben.

|  |  |

| Das Bild im Original | Glück + 50 | Lichtposition -47 |

|  |  |

| Gesichtszug 46 | Augen +45 | Kopfausrichtung -47 |

Das letzte Bild weist kleine Fehler am linken Rand des Kopfes auf, die wohl auf die extreme Veränderung zurück zu führen sind.

Ein weiterer interessanter Filter ist "Hintergrundunschärfe". Er basiert sicher auf "Motiv finden" und lässt sich mit ein paar Reglern anpassen. Die beiden Bilder zeigen an dem Adobe-Stock-Foto, wie er wirken kann.

|

Gerade Smartphone-Fotografen sind solche Filter recht wichtig, da die kleinen Kameras - sofern das Gerät nicht selbst über "KI-Algorithmen" verfügt - im allgemeinen Fotos mit einer sehr großen Tiefenschärfe produzieren.

Fazit

Gerade am "Himmel austauschen" und den letzten Beispielen wird meiner Meinung nach deutlich, dass Bildbearbeitung hier schon zu Manipulation wird. Das muss man wollen - es hat sicherlich nicht immer seine Existenzberechtigung.

Hinweis: Alle Fotos sind von mir aufgenommen oder aus dem Adobe Stock-Pool.